Синтаксис:

Поскольку мы знакомы с ChatGPT, мы знаем, что эта платформа принадлежит сообществу Open AI и предоставляет инструменты, архитектуры, API и несколько сред, которые мы можем использовать при развертывании наших приложений и моделей обработки естественного языка. Open AI предлагает API-интерфейсы, с помощью которых мы можем использовать любые предварительно обученные модели AI и NLP с платформы Open AI и заставить их работать для наших приложений, например, для прогнозирования данных в реальном времени. Аналогичным образом, GPT4All также предоставляет своим пользователям возможность интегрировать свои предварительно обученные модели ИИ с различными приложениями.

Модель GPT4All обучается на ограниченных данных по сравнению с ChatGPT. У него также есть некоторые ограничения производительности по сравнению с ChatGPT, но он позволяет пользователю использовать свой частный GPT на своем локальном оборудовании и не требует каких-либо сетевых подключений. С помощью этой статьи мы узнаем, как мы можем использовать модели GPT4All в скрипте Python, поскольку GPT4All имеет официальные привязки к Python, что означает, что мы также можем использовать и интегрировать модели GPT4All через скрипт Python.

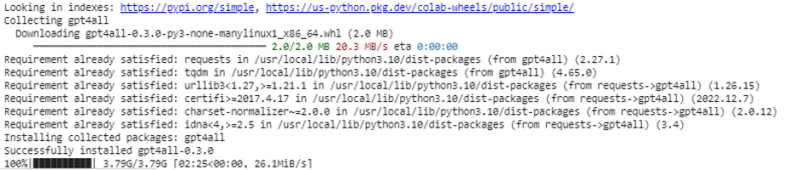

Для установки GPT4All для Python IDE требуется онлайн-команда. Затем мы можем интегрировать столько моделей ИИ, сколько наших приложений. Команда для установки этого GPT4All в Python показана ниже:

$ pip установить gpt4all

Пример 1:

Чтобы начать работу с этим примером, нам нужно загрузить и установить Python в наши системы. Рекомендуемые версии Python — «версия 3.7» или версии, выпущенные после этой версии. Еще один способ работы с Python, позволяющий избежать длительного процесса установки «установки Python» в наших системах, — это использование «Google Colab», облачной среды для Python. Мы можем запустить эту среду в любом веб-браузере и построить модели искусственного интеллекта и машинного обучения. Примеры, которые мы будем реализовывать здесь, выполняются в Google Colab.

В этом примере рассматривается метод установки GPT4All в Python и использование его предварительно обученных моделей. Начнем с первой установки GPT4All. Для этого выполняется команда, о которой мы упоминали ранее. При выполнении команды загружается и устанавливается GPT4All вместе с его пакетами и фреймворками.

Теперь мы движемся вперед. Из GPT4All мы импортируем «GPT4All». Это добавит в проект все предварительно обученные модели из GPT4All. Теперь мы можем использовать любую модель и заставить ее делать прогнозы для нашего приложения. Как только мы импортируем пакет GPT4All, пришло время вызвать эту функцию и использовать модель GPT4All, которая дает результат для «завершения чата».

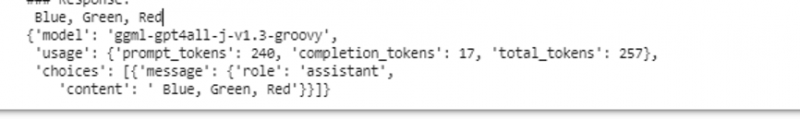

Другими словами, если мы запрашиваем что-либо у этой модели на входе, она возвращает это на выходе. Мы используем здесь модель «ggml-gpt4all-j-v1.3-groovy». Эти модели уже хранятся в кэше GPT4All. Мы можем получить эти модели по этой ссылке » https://github.com/nomic-ai/gpt4all/tree/main/gpt4all-chat ” для ручной загрузки. Если модель уже присутствует в кэше GPT4All, мы просто вызываем имя модели и указываем его в качестве входных параметров функции «GPT4All()». Если вручную скачали успешно, то передаем путь к папке, где находится модель. Поскольку эта модель предназначена для завершения сообщения, синтаксис для этой модели дается следующим образом:

$ Chat_completion (сообщения)Сообщения представляют собой список словарей, и каждый словарь должен содержать ключ «роль» со значением пользователя, системы или помощника, а также содержимое «ключа», которое имеет значение в виде строки. В этом примере мы указываем контент как «назовите три цвета», а ключ роли — как «пользователь».

$model=GPT4All('ggml-gpt4all-j-v1.3-groovy')$messages = [{'role': 'user', 'content': 'Назовите 3 цветка'}]

После этой спецификации мы вызываем функцию «chat_completion()» с моделью. Код для этого отображается в следующем выводе:

$ !pip установить gpt4allиз gpt4all импортировать GPT4All

модель = GPT4All ('ggml-gpt4all-j-v1.3-groovy')

messages = [{'role': 'user', 'content': 'Назовите три цвета'}]

model.chat_completion (сообщения)

После выполнения этого примера модель возвращает три цвета в качестве ответа на ввод.

Пример 2:

Мы рассмотрим еще один пример, в котором мы обнаруживаем другой метод использования GPT4All в Python. Это можно сделать с помощью официальных привязок для Python, предоставляемых Nomic, сообществом искусственного интеллекта с открытым исходным кодом, которое запускает GPT4All. С помощью следующей команды мы интегрируем «nomic» в нашу консоль Python:

$ пип установить номикПосле установки мы импортируем GPT4All из «nomic.gpt4all». После импорта GPT4All мы инициализируем GPT4All с помощью функции «open()». Затем мы вызываем функцию «prompt()» и передаем приглашение этой функции. Затем генерируется ответ на приглашение на основе приглашения, которое мы дали в качестве входных данных для модели приглашения.

!pip установить номикиз nomic.gpt4all импортировать GPT4All

# Инициализировать модель GPT4All

инициировать = GPT4All()

инициировать.открыть()

# Генерация ответа на основе подсказки

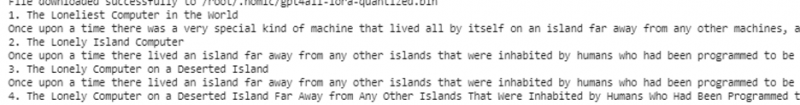

model_response = инициировать.prompt('написать небольшой рассказ о компьютере)

# отображение сгенерированного ответа

печать (модель_ответ)

В выходных данных отображается быстрый ответ модели, созданной с использованием предварительно обученной модели GPT4All в Python. Если мы хотим узнать больше о моделях и о том, как мы можем использовать эти модели для генерации ответов, или, проще говоря, если мы хотим получить знания о синтаксисе для генерации ответов из этих моделей, мы можем получить дополнительную помощь от GPT4Все детали технической документации.

Заключение

GPT4All по-прежнему стремится к точности производительности. Он управляется платформой nomic AI, целью которой является предоставление пользователям чат-ботов с искусственным интеллектом на процессорах потребительского уровня, поскольку GPT4All работает без какого-либо сетевого подключения и графических процессоров. Эта статья помогает нам умело использовать PyGPT4All в среде Python и создавать взаимодействие между нашими приложениями и предварительно обученными моделями искусственного интеллекта GPT4All. В этом руководстве мы рассмотрели два разных метода установки GPT4All в Python.